Gwiazdy "podrabiane" przez AI? Niebezpieczeństwo rośnie

Sztuczna inteligencja od dłuższego czasu coraz śmielej wkrada się do najrozmaitszych dziedzin życia i sektorów gospodarki. Gdzie z jednej strony pojawiają się wielkie marzenia i nadzieje, a codzienna praca staje się prostsza i tańsza, tam z drugiej strony pojawiają się obawy nowych luddystów, podkreślających wagę ludzkiego działania i sygnalizujących konieczność ochrony miejsc pracy. Bez względu jednak na to, czy jesteśmy entuzjastami rozwiązań opartych na AI, czy też jesteśmy wobec wiatrów zmian sceptyczni, nie może umknąć naszej czujności fakt, że sztuczna inteligencja może rodzić szereg niebezpieczeństw – jednym z nich jest „deep fake”. Czym dokładnie jest to zjawisko?

Rozwój sztucznej inteligencji a „deep fake” – o co w tym chodzi?

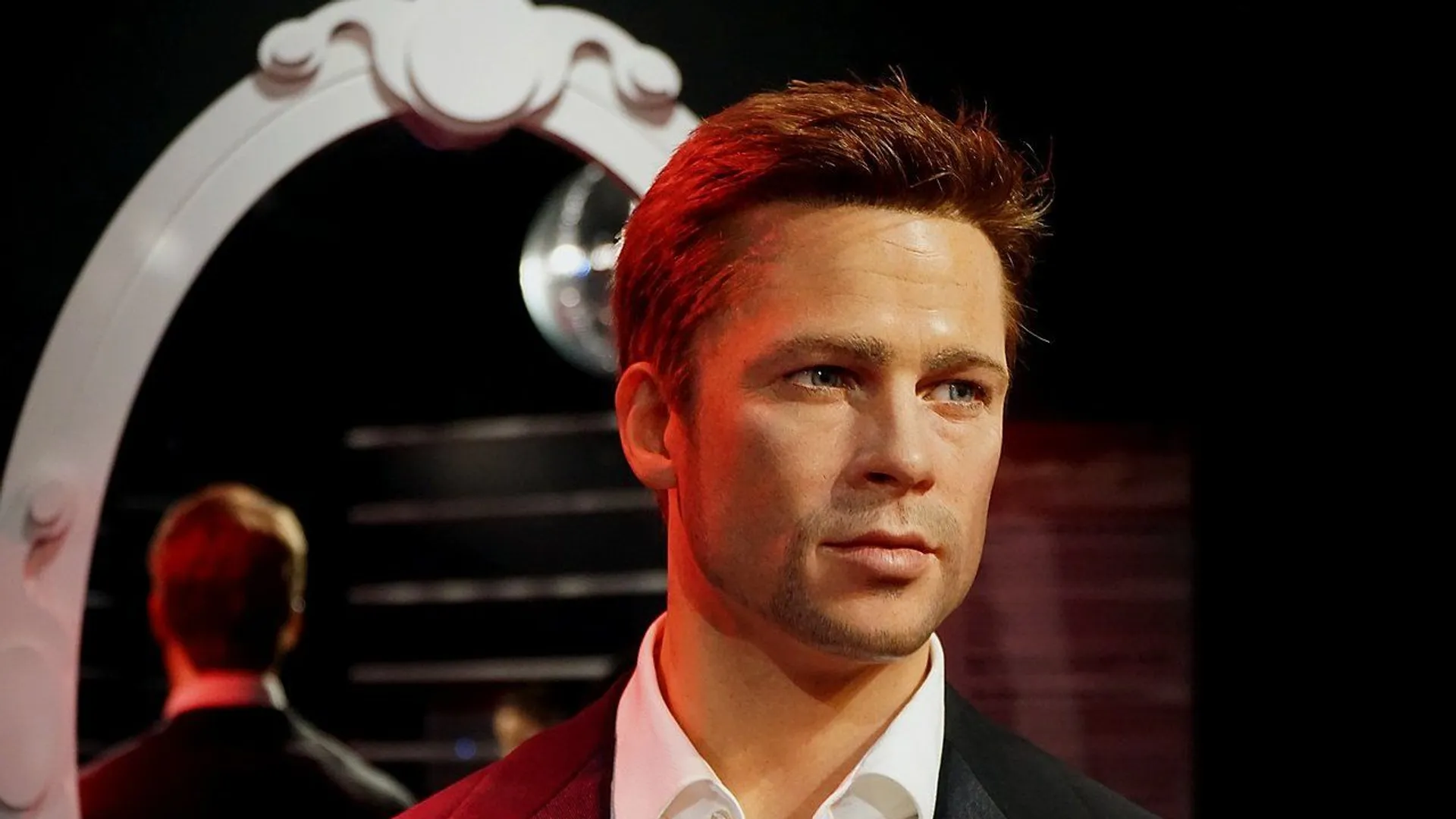

Co jakiś czas, przeglądając newsy o życiu gwiazd, możemy dowiedzieć się, że czyjś wizerunek został bezprawnie wykorzystany – na przykład w kampanii reklamowej. Jeszcze do niedawna oszuści przerabiali w tym celu zdjęcia gwiazd, wykorzystując ich wizerunek na banerach czy w krótkich filmikach, gdzie cały proceder nie był szczególnie wyszukany. Niestety, wraz z rozwojem technologii, rozmaici naciągacze mają do dyspozycji dużo potężniejsze narzędzie – jest nim „deep fake”.

Technologia „deep fake” polega na wykorzystaniu czyjegoś wizerunku – w szczególności osoby znanej – w taki sposób, który osobie nieobeznanej z cyfrowym światem nie pozwoli na wykrycie jakichkolwiek nieprawidłowości. Przy użyciu programów graficznych i programów do obróbki audio/video opartych o sztuczną inteligencję, możliwe jest stworzenie nagrania, w którym dana osoba mówi swoim głosem i porusza się w sposób całkowicie naturalny, jednak w rzeczywistości wszystko jest spreparowaną przez oszusta fikcją.

Przy wykorzystaniu takich nagrań, oszuści mogą zachęcać nieświadome „deep fake’u” osoby do udziału w nielegalnych grach hazardowych, zakupów w często nieistniejących sklepach, czy inwestowania w akcje nieistniejących firm. Technologia „deep fake” może być niestety używana również dla ośmieszania gwiazd i innych osób, czy nawet wrabiania ich w rozmaite, nieprzyjemne sytuacje, które mogą zaszkodzić ich wizerunkowi.

Jak rozpoznać „deep fake” sztucznej inteligencji?

Na całym świecie celebryci coraz częściej ostrzegają przed technologią „deep fake” uczulając swoich fanów na ten proceder, jednocześnie podkreślając, że informacje na swój temat – lub dotyczące swoich współprac z danymi markami – publikują wyłącznie na swoich social mediach czy na innych wiarygodnych kanałach stron trzecich. Sprawdzanie źródła danego nagrania to jedna z podstawowych metod oceny, czy mamy do czynienia z nagraniem autentycznym, czy też manipulacją stworzoną przez AI.

Niewprawne oko może mieć problem z dostrzeżeniem oznak „deep fake’ów”, choć na chwilę obecną nawet najlepsze technologie w tym zakresie nie są pozbawione wad. W przypadku nagrań wygenerowanych przez AI bardzo często będziemy w stanie dostrzec problemy z synchronizacją ust i dźwięku, sztuczną mimikę twarzy, migotanie, a nawet dziwaczne zakłócenia (głównie w obrębie gałek ocznych).